23.04.2026 - Fachartikel

Digitalrendite: Wie Sie den Mehrwert von Digitalisierung messbar machen

Digitalisierung kostet: Zeit, Budget, Energie und Aufmerksamkeit der Organisation. Neue Software einführen, Prozesse anpassen, Mitarbeiter schulen. Und trotzdem kommen irgendwann die Fragen: Was bringt das am Ende wirklich? Können Sie belegen, dass es sich gelohnt hat? Genau hier setzt der Begriff Digitalrendite an. Er beschreibt den messbaren Mehrwert, den digitale Maßnahmen tatsächlich bringen. Nicht nur in Euro, sondern z. B. als Zeitersparnis, weniger Fehler, bessere Planung und schnellere Entscheidungen.

In diesem Artikel erfahren Sie, was Digitalrendite wirklich bedeutet, warum klassische ROI-Betrachtungen oft zu kurz greifen und weshalb das Thema besonders im öffentlichen Sektor an Bedeutung gewinnt. Sie bekommen eine einfache Messlogik, einen KPI-Baukasten und einen Ablauf, mit dem Sie Digitalrendite Schritt für Schritt aufbauen. Zum Schluss zeigen wir am Beispiel von BCS, wie sich Projekte, Ressourcen und Controlling so verbinden lassen, dass Nutzen im Alltag wirklich sichtbar wird.

Digitalrendite auf einen Blick

Digitalisierung allein erzeugt keinen Mehrwert, erst messbare Wirkung schafft Digitalrendite.

Klassischer ROI greift zu kurz: Digitalrendite berücksichtigt auch Zeitgewinn, Qualität, Transparenz und Steuerungsfähigkeit.

Wirkung wird steuerbar, wenn Baseline, klare KPIs und eine saubere Wirklogik (Input → Outcome → Impact) definiert sind.

Im öffentlichen Sektor bedeutet Rendite Public Value: nicht Gewinn, sondern bessere Leistungen und höhere Handlungsfähigkeit.

Durchgängige Koordination von Projekten, Ressourcen und Controlling ist der entscheidende Hebel, um Digitalrendite nachhaltig zu realisieren.

Inhalt

Was ist Digitalrendite?

Definition Digitalrendite

Digitalrendite ist der messbare Nutzen digitaler Maßnahmen minus ihres Aufwands über finanzielle und nicht-finanzielle Effekte hinweg.

Diese Definition wirkt auf den ersten Blick simpel. In der Praxis steckt darin jedoch ein entscheidender Perspektivwechsel. Während klassische Wirtschaftlichkeitsbetrachtungen fast ausschließlich auf Kosten und monetäre Erträge schauen, berücksichtigt Digitalrendite auch Effekte, die sich nicht direkt in Euro ausdrücken lassen, die aber den Alltag einer Organisation spürbar verändern.

Dazu zählen unter anderem:

eingesparte Bearbeitungszeit

geringere Fehlerquoten

bessere Planbarkeit

höhere Servicequalität

mehr Transparenz und Steuerungsfähigkeit

Digitalrendite ist kein Ersatz für klassische Wirtschaftlichkeitskennzahlen wie ROI (Return on Investment) oder TCO (Total Cost of Ownership), sondern eine Erweiterung. Während der ROI Zahlungsströme betrachtet und der TCO Gesamtkosten beschreibt, fokussiert Digitalrendite auf die Wirkung digitaler Maßnahmen im operativen Alltag.

Sie beantwortet damit eine andere Frage: nicht „Rechnet sich die Investition finanziell?“, sondern „Welche messbaren Veränderungen treten durch die Maßnahme im System Organisation auf?“

ROI vs. Digitalrendite

Digitalisierung wirkt selten nur an einer Stelle, sondern entlang kompletter Prozesse. Digitalrendite macht diese Wirkung sichtbar, wo ein klassischer ROI blind bleibt.

| ROI | Digitalrendite |

| monetär | monetär und nicht-monetär |

| punktuell | prozessübergreifend |

| rückblickend | auch steuernd & vorausschauend |

| Investition im Fokus | Wirkung im Fokus |

Gerade bei komplexen Digitalprojekten, z. B. in Projektarbeit, Dienstleistungen oder Verwaltung, ist der ROI allein oft kein ausreichender Maßstab. Die Gegenüberstellung vereinfacht bewusst. In der Praxis ergänzen sich beide Perspektiven:

ROI bleibt relevant für Investitionsentscheidungen

Digitalrendite ergänzt die operative Steuerung

Problematisch wird es, wenn Digitalrendite-Effekte pauschal in monetäre Werte übersetzt werden, ohne die zugrunde liegenden Annahmen offenzulegen (z. B. bei Zeitgewinnen ohne reale Kapazitätsanpassung).

Digitalisierung vs. Digitalisierungserfolg

Ein weiterer häufiger Denkfehler ist die Gleichsetzung von Digitalisierung und Erfolg.

| Folgendes beschreibt Aktivitäten/Fakten | Zentral ist aber der Nutzen / die messbare Auswirkung |

| Wir haben ein neues Tool eingeführt. | Bearbeitungszeiten sind gesunken. |

| Der Prozess ist jetzt digital. | Fehler wurden reduziert. |

| Die Daten liegen im System. | Entscheidungen werden schneller und fundierter getroffen. |

Merksatz

Digitalisierung ist die Voraussetzung, Digitalrendite ist das Ergebnis.

Typische Missverständnisse rund um Digitalrendite

| Missverständnis | Was wirklich dahintersteckt |

| „Wir haben Software eingeführt, also haben wir Nutzen realisiert.“ | Software allein verändert noch keine Realität. Erst wenn Prozesse angepasst, Rollen geklärt und Nutzung etabliert sind, entsteht messbarer Mehrwert. |

| „Mehr Daten führen automatisch zu besseren Entscheidungen.“ | Ohne klare Fragen und saubere Daten erzeugen Zahlen vor allem mehr Verwirrung und Komplexität. Digitalrendite entsteht nicht durch Datensammlung, sondern durch steuerungsrelevante Informationen. |

| „Der Nutzen zeigt sich schon irgendwann.“ | Ohne klare Zielgrößen und Messpunkte bleibt Nutzen unscharf und damit nicht steuerbar. |

Warum Digitalrendite zum Steuerungsinstrument wird, statt Buzzword zu bleiben

Drei Gründe sorgen dafür, dass viele Organisationen an Digitalrendite nicht mehr vorbeikommen:

1. Anhaltender Budgetdruck

Ob Unternehmen oder öffentliche Organisationen: Investitionen müssen begründet, priorisiert und verteidigt werden. Wenn niemand den Nutzen sieht, wird Digitalisierung intern schnell zur Dauer-Diskussion.

2. Fachkräftemangel als strukturelles Problem

Wenn Personal knapp ist, müssen Prozesse effizienter werden. Digitalisierung soll entlasten; Ob sie das wirklich tut, zeigt erst die Digitalrendite.

3. Steigende Erwartungen an Servicequalität

Kunden, Auftraggeber und Bürger erwarten digitale Angebote, die funktionieren, verständlich sind und Zeit sparen. Diese Erwartungen lassen sich nur erfüllen, wenn Wirkung gezielt gesteuert wird.

Digitalrendite als gemeinsame Sprache in der Organisation

Ein oft unterschätzter Vorteil: Digitalrendite verbindet Perspektiven.

Sie schafft eine gemeinsame Bewertungsgrundlage für:

Management und Führungskräfte

Fachbereiche und Projektverantwortliche

IT und Organisation

Controlling und Strategie

Statt abstrakter Diskussionen über „Digitalisierung“ geht es um konkrete Fragen:

Welches Vorhaben bringt den größten Nutzen?

Wo setzen wir unsere knappen Ressourcen ein?

Welche Effekte sind bereits messbar und welche nicht?

Digitalrendite macht Entscheidungen vergleichbar, transparent und begründbar.

Was ohne Digitalrendite passiert

Fehlt diese Steuerungslogik, zeigen sich in vielen Organisationen ähnliche Symptome:

Projektfriedhof: Initiativen werden gestartet, aber nicht konsequent genutzt oder weiterentwickelt.

Schatten-IT: Fachbereiche weichen auf eigene Lösungen aus, weil zentrale Systeme keinen spürbaren Mehrwert liefern.

Geringe Akzeptanz: Mitarbeiter erleben Digitalisierung als zusätzliche Belastung statt als Unterstützung.

Medienbrüche bleiben bestehen: Digitale Inseln ersetzen keine durchgängigen Prozesse.

Ohne Digitalrendite wird Digitalisierung zum Selbstzweck. Mit Digitalrendite wird sie steuerbar.

Digitalrendite in Unternehmen: wo der Mehrwert typischerweise entsteht

Digitalrendite zeigt sich in Unternehmen besonders dort, wo Digitalisierung operative Abläufe mit Steuerung und Transparenz verbindet. Vier Werthebel sind dabei besonders relevant.

Werthebel 1: Umsatz & Marge

Digitalisierung wirkt hier vor allem indirekt, aber nachhaltig:

schnellere Angebots- und Sales-Prozesse

bessere Nachverfolgbarkeit von Chancen und Projekten

kürzere Durchlaufzeiten bis zur Leistungserbringung

höhere Auslastung von Teams und Ressourcen

Ergebnis: Leistungen werden schneller fakturierbar, Projekte wirtschaftlicher planbar und Margen stabiler.

Werthebel 2: Kosten & Effizienz

Ein klassischer, aber oft unterschätzter Hebel:

Automatisierung manueller Tätigkeiten

weniger Fehler durch klare Workflows

Reduktion von Nacharbeit und Doppelpflege

kürzere Bearbeitungs- und Abstimmungszeiten

Gerade bei projektorientierten Dienstleistern entstehen hier schnell spürbare Zeitgewinne, die sich direkt in Produktivität übersetzen lassen.

Werthebel 3: Steuerung & Prognosefähigkeit

Hier zeigt sich Digitalrendite besonders deutlich auf Managementebene:

belastbare Ressourcenplanung

laufendes Projektcontrolling

realistische Forecasts statt Bauchgefühl

bessere Cashflow-Sicht durch frühzeitige Transparenz

Digitalrendite bedeutet hier: Weniger Überraschungen, mehr Planbarkeit, bessere Entscheidungen.

Werthebel 4: Risikoreduktion & Compliance

Oft kein primäres Ziel, aber ein entscheidender Effekt:

saubere Dokumentation von Projekten und Entscheidungen

höhere Audit- und Revisionssicherheit

bessere Vertragserfüllung

belastbare Nachkalkulationen als Lernbasis

Diese Effekte senken Risiken, vermeiden Folgekosten und stärken die organisatorische Resilienz.

Warum Digitalrendite im öffentlichen Sektor besonders relevant ist

Im öffentlichen Sektor steht Digitalisierung unter einem besonderen Erwartungsdruck. Einerseits sollen Verwaltungen moderner, schneller und bürgernäher werden. Andererseits sind Budgets begrenzt, rechtliche Vorgaben eng und Veränderungen politisch wie organisatorisch sensibel. Genau in diesem Spannungsfeld hilft Digitalrendite als einfache Leitfrage: Was hat sich wirklich verbessert?

Denn anders als in Unternehmen lässt sich der Erfolg digitaler Vorhaben hier nicht einfach an Umsatz oder Gewinn ablesen. Dennoch und gerade deshalb muss beantwortet werden, ob und wie Digitalisierung tatsächlich wirkt. Digitalrendite schafft dafür einen Bezugsrahmen, der Wirkung sichtbar macht, ohne eine Gewinnlogik zu erzwingen.

„Rendite“ ohne Gewinnlogik: Public Value statt Profit

Wenn im öffentlichen Sektor von „Rendite“ gesprochen wird, ist damit kein finanzieller Überschuss gemeint. Die eigentliche Rendite besteht im gesellschaftlichen Nutzen, also darin, wie gut staatliches Handeln seinen Zweck erfüllt. Digitalisierung soll dabei helfen, Leistungen verständlicher, zugänglicher und verlässlicher zu machen. Die „Rendite“ öffentlicher Digitalisierung zeigt sich deshalb nicht in Margen, sondern im Public Value.

Dieser Nutzen entfaltet sich auf mehreren Ebenen:

Bürger und Unternehmen profitieren von verständlichen, schnellen und zuverlässigen Services.

Mitarbeiter werden durch klarere Prozesse, bessere Werkzeuge und weniger Medienbrüche entlastet.

Der Staat gewinnt an Handlungsfähigkeit, Transparenz und Vertrauen.

Statt der Frage „Was bringt uns das finanziell?“ steht im Vordergrund: „Welche Wirkung erzielen wir mit den eingesetzten Ressourcen?“

Digitalrendite übersetzt diesen Public Value in eine strukturierte Betrachtung: Nicht ob digitalisiert wurde, sondern was sich dadurch konkret verbessert hat.

Besonderheiten der Verwaltungsrealität

Die Messung und Steuerung von Digitalrendite ist im öffentlichen Sektor anspruchsvoller als in vielen Unternehmen. Dafür gibt es strukturelle Gründe:

Rechtliche Rahmenbedingungen begrenzen Spielräume und verlangsamen Anpassungen.

Haushaltslogiken trennen Investitions- und Betriebskosten und erschweren ganzheitliche Betrachtungen.

Vergabe- und Beschaffungsprozesse verlängern Umsetzungszyklen.

Föderale Strukturen führen zu unterschiedlichen Zuständigkeiten, Standards und IT-Landschaften.

Notwendige Standardisierung steht oft im Spannungsfeld zu individuellen Fachanforderungen.

In diesem Umfeld hilft Digitalrendite, Komplexität zu reduzieren, ohne sie zu ignorieren. Sie zwingt dazu, den Blick auf Wirkung und Nutzen zu richten und nicht allein auf Maßnahmen, Programme oder eingesetzte Mittel.

Wo Digitalrendite in der Verwaltung typischerweise sichtbar wird

Der Nutzen digitaler Maßnahmen zeigt sich in der Verwaltung selten spektakulär, aber sehr deutlich im Alltag. Er liegt oft in vielen kleinen Verbesserungen entlang eines Prozesses, die zusammengenommen eine große Wirkung entfalten. Wenn Anträge nicht mehr ausgedruckt, weitergereicht und manuell erfasst werden müssen, sinken Bearbeitungszeiten. Wenn Daten konsistent vorliegen, können Mitarbeiter schneller Auskunft geben. Wenn Prozesse klar strukturiert sind, reduzieren sich Rückfragen, intern wie extern. Genau hier entsteht Digitalrendite: in weniger Reibung, mehr Verlässlichkeit und besserer Planbarkeit.

Typische Effekte sind:

weniger Medienbrüche zwischen Online-Services und interner Bearbeitung

kürzere Bearbeitungs- und Durchlaufzeiten

bessere Auskunftsfähigkeit gegenüber Bürgern und politischen Gremien

geringere Rückfragenquoten durch klarere Prozesse und Datenlagen

Diese Effekte mögen einzeln klein wirken. In Summe führen sie jedoch zu spürbaren Entlastungen, höherer Qualität und besserer Steuerbarkeit, also zu echter Digitalrendite.

Akzeptanz als Renditefaktor

Ein zentraler Punkt wird in Digitalisierungsprojekten häufig übersehen: Wirkung entsteht nur dort, wo Angebote auch genutzt werden. Ein technisch funktionierender Online-Service, den niemand verwendet, erzeugt keine Digitalrendite.

Nutzerfreundlichkeit ist deshalb kein „weiches“ Thema, sondern ein harter Erfolgsfaktor. Je verständlicher, barriereärmer und zuverlässiger ein digitales Angebot ist, desto höher ist seine Nutzung. Und je höher die Nutzung, desto größer ist der tatsächliche Entlastungseffekt für Organisation und Mitarbeiter.

Mehr Nutzung, mehr Wirkung, höhere Digitalrendite.

Akzeptanz wirkt dabei wie ein Verstärker: Sie entscheidet darüber, ob Digitalisierung im Alltag ankommt oder wirkungslos bleibt.

Das Messproblem: Wie macht man Digitalrendite „sauber“ messbar?

So überzeugend der Gedanke der Digitalrendite ist, so häufig scheitert er an der Umsetzung. Nicht, weil Wirkung grundsätzlich nicht messbar wäre, sondern weil Messung oft zu spät, zu kompliziert oder ohne klare Zielsetzung erfolgt. Der Trick ist: erst die Wirkung klären, dann messen.

Von Input zu Impact: Wirkung statt Maßnahme messen

Viele Digitalprojekte bleiben auf der Ebene des Inputs stehen: Budget, Projektlaufzeit, Anzahl umgesetzter Funktionen. Diese Größen sagen jedoch wenig darüber aus, ob sich etwas verbessert hat.

Eine wirkungsorientierte Betrachtung unterscheidet zwischen dem, was investiert wurde, dem, was bereitgestellt wird, und dem, was sich tatsächlich verändert. Erst wenn klar wird, welche Effekte eine Maßnahme im Alltag auslöst, z. B. Zeitersparnis, geringere Fehler oder bessere Steuerung, lässt sich von Digitalrendite sprechen.

Bewährt hat sich eine mehrstufige Betrachtung, die Ursache und Wirkung sauber trennt:

Input: eingesetzte Ressourcen (Budget, Zeit, Personal, Software)

Output: erbrachte Leistungen (z. B. digitalisierte Anträge, automatisierte Prozesse)

Outcome: direkte Effekte (Zeitersparnis, geringere Fehlerquote, bessere Steuerung)

Impact: übergeordnete Wirkung (Servicequalität, Zufriedenheit, Vertrauen, Effizienz)

Digitalrendite entsteht vor allem auf der Outcome- und Impact-Ebene, nicht allein durch den Output. Wichtig ist dabei: Nicht jede Wirkung muss sofort gesellschaftlichen „Impact“ haben. Oft reicht es, konkrete Verbesserungen auf Prozessebene sichtbar zu machen.

Kausalität und Einflussfaktoren

Ein zentrales methodisches Problem besteht darin, beobachtete Effekte eindeutig digitalen Maßnahmen zuzuordnen. Veränderungen bei Bearbeitungszeiten, Fehlerquoten oder Servicequalität können auch durch andere Faktoren beeinflusst sein, etwa:

organisatorische Umstrukturierungen

Personalveränderungen oder Lernkurveneffekte

saisonale Schwankungen im Arbeitsaufkommen

parallele Optimierungsmaßnahmen

Digitalrendite-Messung sollte diese Einflussfaktoren zumindest qualitativ berücksichtigen. Ziel ist nicht perfekte Kausalität, sondern eine nachvollziehbare und konsistente Wirkungsinterpretation.

Baseline und Vergleich: Ohne Ausgangspunkt keine Aussage

Ein häufiger Fehler ist es, erst nach der Einführung eines Systems über Messung nachzudenken. Dann fehlt der Vergleich. Ohne einen Ausgangswert bleibt unklar, ob sich etwas verbessert hat oder ob es nur ein Gefühl ist.

Deshalb ist es entscheidend, frühzeitig einfache Vergleichspunkte zu definieren. Das können Bearbeitungszeiten vor und nach der Umstellung sein, Pilotbereiche im Vergleich zum Regelbetrieb oder klar abgegrenzte Prozessschritte. Es geht nicht um wissenschaftliche Perfektion, sondern um nachvollziehbare Entwicklung.

Geeignete Ansätze sind:

Vorher-Nachher-Vergleiche

Pilotprojekte mit klar abgegrenztem Umfang

Prozesszeitmessungen entlang definierter Schritte

Vergleich ähnlicher Organisationseinheiten (wo möglich)

Wichtig ist weniger statistische Perfektion als Konsistenz und Nachvollziehbarkeit.

Wird z. B. die Bearbeitungszeit eines Antragsprozesses gemessen, sollte die Baseline über mehrere Wochen oder Monate erhoben werden. Einzelmessungen sind anfällig für Verzerrungen. Erst wenn Vergleichszeiträume konsistent definiert sind (gleiche Falltypen, gleiche Prozessdefinition), lassen sich belastbare Aussagen über Veränderungen treffen.

Monetär vs. nicht-monetär und wie man beides zusammenführt

Nicht jeder Nutzen lässt sich sinnvoll in Euro ausdrücken. Zeitgewinne können zwar monetarisiert werden, doch oft liefern qualitative Kennzahlen ein realistischeres Bild. Zufriedenheit, Transparenz oder Planbarkeit sind schwer zu bepreisen, aber entscheidend für die tatsächliche Wirkung.

Eine gute Digitalrendite-Betrachtung kombiniert daher beides: Dort, wo es sinnvoll ist, werden Effekte quantifiziert. Dort, wo das nicht möglich oder zielführend ist, werden qualitative Indikatoren ergänzt. Entscheidend ist nicht die exakte Zahl, sondern die Richtung und Belastbarkeit der Aussage.

Zeitgewinne können optional monetarisiert werden (z. B. Stunden × Kostenansatz).

Qualitäts- und Zufriedenheitsmetriken ergänzen das Bild.

Steuerungskennzahlen zeigen Trends, nicht absolute Wahrheiten.

Ziel ist kein exakter Wert, sondern eine belastbare Entscheidungsgrundlage.

Eine Reduktion der Bearbeitungszeit um 10 Minuten bei 15.000 Fällen pro Jahr entspricht rechnerisch 2.500 Stunden. Entscheidend ist jedoch die Interpretation: Wird diese Zeit tatsächlich eingespart (z. B. durch Personalabbau)? Oder entsteht zusätzliche Kapazität für andere Aufgaben? Nur im ersten Fall entsteht ein direkter finanzieller Effekt. Im zweiten Fall handelt es sich um eine Effizienzsteigerung ohne unmittelbaren Kosteneffekt, aber mit potenziell höherem Output oder besserer Servicequalität.

Typische Messfallen und wie man sie vermeidet

In der Praxis scheitert Messung selten am fehlenden Willen, sondern an strukturellen Problemen:

- Übermessung: Zu viele KPIs führen zu Intransparenz statt Klarheit

- fehlende Konsistenz: KPIs werden im Zeitverlauf unterschiedlich definiert

- Anreizverzerrung („Gaming“): Kennzahlen werden optimiert, ohne reale Verbesserung

- Messung ohne Nutzung: Daten werden erhoben, aber nicht zur Steuerung verwendet

Fachlich belastbare Digitalrendite erfordert daher nicht viele Kennzahlen, sondern wenige, konsistent definierte und tatsächlich genutzte Steuerungsgrößen.

Digitalrendite braucht deshalb

klare Ziele

einfache Logik

ehrliche Interpretation

Grenzen von Digitalrendite

Trotz ihres Nutzens ist Digitalrendite kein Allheilmittel.

Nicht alle Effekte lassen sich sinnvoll messen oder eindeutig zuordnen

Der Aufwand für Messung kann den Nutzen übersteigen

Langfristige Wirkungen (z. B. Kulturveränderungen) entziehen sich kurzfristiger Bewertung

Zudem besteht die Gefahr, dass nur messbare Effekte priorisiert werden, während schwer quantifizierbare, aber strategisch relevante Aspekte in den Hintergrund treten.

Digitalrendite sollte daher als Entscheidungsunterstützung verstanden werden, nicht als alleinige Bewertungslogik.

KPI-Baukasten: Kennzahlen für Digitalrendite (Unternehmen & öffentlicher Bereich)

Digitalrendite ist kein Zahlenwerk, das man einmal erstellt und dann abhakt. Sie ist ein Denk- und Steuerungsrahmen, der hilft, Digitalisierung wirksam zu gestalten. Weniger Listen, weniger Symbolpolitik und mehr Fokus auf das, was sich im Alltag wirklich verbessert.

Kennzahlen sind kein Ziel an sich. Sie sind Werkzeuge, um Entwicklungen sichtbar zu machen und Entscheidungen zu unterstützen. Deshalb gibt es auch nicht „die eine“ richtige Kennzahl für Digitalrendite.

Stattdessen ist ein Baukasten sinnvoll, aus dem Organisationen je nach Zielsetzung auswählen. In der Praxis haben sich vier Perspektiven bewährt.

Wichtig vorab

Die folgenden genannten Kennzahlen sind Orientierungswerte aus Praxisprojekten, keine Normen. Entscheidend ist der Vergleich vorher vs. nachher, nicht der absolute Wert.

Sie sind als praxisnaher Baukasten zu verstehen. Entscheidend ist nicht, möglichst viele KPIs zu erfassen, sondern wenige, klar definierte und konsistent gemessene Größen auszuwählen.

Orientierungswerte ersetzen keine Baseline. Belastbare Aussagen entstehen erst durch den Vergleich von Vorher und Nachher bei gleichbleibender Messdefinition, vergleichbaren Falltypen und nachvollziehbarer Datengrundlage.

KPI-Baukasten: Kennzahlen für Digitalrendite

Hier zeigt sich, ob Digitalisierung Abläufe tatsächlich vereinfacht. Wenn Durchlaufzeiten sinken, manuelle Übergaben entfallen oder Rückfragen abnehmen, ist das ein klares Signal für Wirkung. Diese Kennzahlen sind besonders greifbar, weil sie direkt an den Arbeitsalltag anschließen.

Methodischer Hinweis: Prozess-KPIs sind nur dann belastbar vergleichbar, wenn dieselben Prozessgrenzen gelten. Wird z. B. „Antragseingang“ oder „Abschluss“ im Zeitverlauf unterschiedlich definiert, verlieren die Werte ihre Aussagekraft.

- Typische Effekte durch Digitalisierung: -20 % bis -50 %

- In stark manuellen Prozessen (Anträge, Freigaben, Projektabstimmungen) sind auch -60 % erreichbar.

- Beispiel: Ein Antrag, der früher 10 Tage benötigte, liegt nach Digitalisierung bei 4–6 Tagen.

- Ausgangslage in vielen Organisationen: 10–30 %

- Realistisches Ziel nach Prozessdigitalisierung: 40–70 %, je nach Komplexität

- Entscheidend ist nicht Vollautomatisierung, sondern die Reduktion manueller Übergaben.

- Vor Digitalisierung oft: 30–50 % der Vorgänge mit mindestens einer Rückfrage

- Nach Standardisierung und klaren digitalen Formularen: unter 15–20 %

- Jede vermiedene Rückfrage spart Zeit auf beiden Seiten.

- Typischer Rückgang: -20 % bis -40 %

- Besonders relevant bei Medienbrüchen und manueller Datenerfassung.

- In historisch gewachsenen Prozessen häufig hoch

- Ziel ist eine deutliche Reduktion manueller Übertragungen zwischen Systemen, Dateien oder Papier und System

- Besonders relevant für Verwaltungs- und Projektprozesse mit vielen Übergaben

Vor allem für projektorientierte Dienstleister spielt die wirtschaftliche Perspektive eine zentrale Rolle. Auslastung, Planungsgenauigkeit oder Abweichungen zwischen Kalkulation und Realität zeigen, ob Digitalisierung hilft, Leistungen besser zu steuern und Risiken früher zu erkennen.

Methodischer Hinweis: Finanz- und Steuerungs-Kennzahlen gewinnen an Aussagekraft, wenn Planwerte nicht nachträglich „glattgezogen“ werden. Nur mit stabiler Baseline werden Plan/Ist-Abweichungen und Forecasts wirklich steuerungsrelevant.

- Häufige Ausgangslage: 60–70 %

- Gute, realistische Zielwerte: 75–85 %

- Alles darüber erhöht das Risiko von Überlastung und Qualitätsverlust.

- Vor strukturierter Projekt- und Leistungserfassung: 50–65 %

- Nach Einführung klarer Projekt- und Zeiterfassungslogik: 70–80 %

- Typische Abweichung ohne saubere Steuerung: ±20–30 %

- Mit laufendem Projektcontrolling: ±5–10 %

- Ein enormer Hebel für Planungssicherheit.

- Zielwert: unter 10 %, langfristig unter 5 %

- Voraussetzung, um aus Projekten systematisch zu lernen.

- Reduktion durch saubere Leistungsnachweise und Abrechnung: -10 bis -20 Tage sind realistisch.

- Typisch ohne durchgängige Projektsteuerung: deutliche Schwankungen zwischen Planung und Realität

- Ziel ist nicht Nullabweichung, sondern frühzeitige Erkennbarkeit und bessere Steuerbarkeit

- Besonders relevant im Multiprojekt- und Portfoliokontext

Im öffentlichen Sektor ist Nutzung ein entscheidender Indikator. Digitale Angebote entfalten ihren Nutzen nur dann, wenn sie angenommen werden. Abschlussquoten, Abbrüche oder Erstlösungsraten geben Hinweise darauf, ob Services verständlich und praxistauglich sind.

Methodischer Hinweis: Service-KPIs sollten nicht isoliert interpretiert werden. Eine hohe Nutzung ist nur dann ein Erfolg, wenn Qualität, Verständlichkeit und Bearbeitbarkeit im Hintergrund ebenfalls gewährleistet sind.

- Viele digitale Verwaltungsleistungen starten bei 30–50 %

- Gut gemachte, verständliche Services erreichen 70–90 %

- Nutzung ist der wichtigste Wirkungsindikator.

- Kritischer Schwellenwert: >30 %

- Zielbereich: unter 15–20 %

- Alles darüber weist auf Verständlichkeits- oder Medienbruchprobleme hin.

- Vor Digitalisierung: häufig 50–60 %

- Nach klaren Prozessen und Datenverfügbarkeit: 75–85 %

- Ziel ist weniger die absolute Note als die Verbesserung.

- Typische Effekte: +0,5 bis +1,0 Notenstufe oder +15–25 % im Score

- Zeigt, ob digitale Angebote analoge oder manuelle Kanäle tatsächlich entlasten

- Besonders relevant bei Omnichannel- oder Verwaltungsleistungen mit Papier-Alternative

- Ein zentraler Hebel für Public Value und interne Entlastung

Nicht zuletzt wirkt Digitalisierung nach innen. Wenn Einarbeitungszeiten sinken, Abstimmungsaufwand abnimmt oder Transparenz steigt, entsteht langfristige Entlastung. Diese Effekte lassen sich oft gut über gezielte Befragungen oder einfache Indikatoren erfassen.

Methodischer Hinweis: Organisations- und Mitarbeiter-KPIs sind häufig indirekt. Gerade deshalb sollten sie nicht als „weiche“ Kennzahlen abgetan werden, sondern mit standardisierten Fragen, festen Intervallen und konsistenter Auswertung erhoben werden.

- Reduktion um 20–40 % bei klaren, standardisierten Abläufen

- Häufiger Ausgangswert: 40–60 % Zustimmung

- Nach strukturierter Projekt- und Ressourcensteuerung: 70–85 %

- Reduktion um 15–30 % realistisch

- Weniger Statusmeetings, weil Informationen verfügbar sind.

- Besonders relevant bei Projekt-, Ressourcen- und Controlling-Daten

- Typischer Quick Win nach Standardisierung: deutlich weniger unvollständige oder widersprüchliche Datensätze

- Grundvoraussetzung für belastbare Digitalrendite-Messung

- Ein zentraler Frühindikator für spätere Digitalrendite

- Zeigt, ob Prozesse wirklich im System gelebt werden oder Schattenlösungen bestehen bleiben

- Besonders wichtig in Einführungs- und Pilotphasen

Digitalrendite zeigt sich nicht in einzelnen Idealwerten, sondern in konsistenten Verbesserungen über mehrere Kennzahlen hinweg. Wenn mehrere KPIs gleichzeitig in die richtige Richtung laufen (schneller, stabiler, planbarer, verständlicher) dann entsteht belastbare Digitalrendite.

Der Praxisprozess in sechs Schritten: Digitalrendite systematisch planen und realisieren

Digitale Vorhaben ohne klaren Plan führen häufig zu Messung ohne Aussage und Implementierung ohne Wirkung. Um Digitalrendite systematisch zu heben, braucht es einen nachvollziehbaren Prozess, der von Nutzenhypothese bis Kontinuierlicher Verbesserung reicht, basierend auf Methoden aus der Digitalisierungs- und Wirkungsorientierungsdiskussion (z. B. Wirkungslogik Input-Output-Outcome-Impact, wie sie auch der DigitalService des Bundes beschreibt).

Schritt 1: Ziele & Nutzenhypothesen festlegen

Der Startpunkt ist nicht die Technologie, sondern die Nutzenfrage: Woran merken Sie, dass Digitalisierung Wirkung erzeugt?

Eine typische Formulierung könnte lauten: „Nach Einführung der digitalen Lösung sinkt die durchschnittliche Bearbeitungszeit um mindestens 40 % im Vergleich zu heute.“ Solche Ziele formulieren nicht nur eine Richtung, sie machen Wirkungsvermutungen messbar und überprüfbar. Das ist ein Ansatz, den auch praxisnahe Wirkungsrahmen betonen (z. B. Messziele im Wirkungsmodell des DigitalService).

Zentral sind dabei:

Zielbeschreibung in klarem, operationalem Text

Nutzenhypothese, die direkt messbar ist

Zielgröße & Zeitraum („bis Ende 2026 …“)

Wenn diese Hypothesen schon zu Beginn klar sind, dient das der gesamten Steuerungslinie des Projektes. Wichtig ist, dass Nutzenhypothesen falsifizierbar sind. Eine Formulierung wie „Prozesse werden effizienter“ ist nicht überprüfbar.

Besser sind konkrete Zielwerte mit Zeitbezug, die auch verfehlt werden können.

Schritt 2: Prozesse mit größtem Hebel auswählen

Nicht jeder Prozess eignet sich als erstes Pilotfeld. Wählen Sie jene Prozesse, bei denen hohe Volumina, großer Schmerz und viele Medienbrüche zusammenkommen. Diese Kriterien helfen, Fokus zu schaffen und das begrenzte Veränderungskapital dort einzusetzen, wo der Renditehebel am größten ist.

Beispiele für starke Hebelprozesse:

Antragserledigung mit hohem Volumen

Serviceprozesse mit vielen manuellen Übergaben

Compliance- oder Berichtspflichten, die aktuell viele Rückfragen erzeugen

Hier zeigt sich auch, dass Digitalisierung nicht auf Technologie abzielt, sondern auf Prozessverbesserung und spürbare Reduktion von Reibungspunkten zwischen Beteiligten und Systemen.

Schritt 3: Messdesign (Baseline, Datenquellen, Rhythmus)

Wer misst, muss wissen, wann, was und wie oft gemessen wird. Ein solides Messdesign hat folgende Bestandteile:

Baseline definieren: Was war der Zustand vor der Maßnahme?

Datenquellen festlegen: Nutzungssysteme, Logdateien, Zeitstempel, Mitarbeiter-Erhebungen

Messrhythmus bestimmen: Wöchentliche, monatliche oder quartalsweise Messungen

Die Herausforderung liegt hier weniger in der Technik als in der Disziplin, Daten konsistent und vergleichbar zu erheben.

Beispiel: Wenn Sie Bearbeitungszeiten messen, brauchen Sie vor der Einführung eine Baseline über mehrere Wochen, erst dann sind Veränderungen interpretierbar.

Ein häufiges Problem in der Praxis ist die nachträgliche Definition von KPIs. Wird erst nach der Einführung gemessen, fehlt die Vergleichsbasis. Messdesign ist daher integraler Bestandteil der Projektplanung und kein nachgelagerter Schritt.

Schritt 4: Umsetzung in Iterationen

Statt „Big Bang“ empfiehlt sich ein inkrementeller Ansatz:

- Minimum Viable Product (MVP): kleinster realisierbarer Nutzen

- Pilotbetrieb: für begrenzten Kreis und kurzen Zeitraum

- Skalierung und Standardisierung: nach erfolgreichem Pilot

Ein iterativer Prozess erlaubt schnelle Rückkopplung, frühzeitige Messung und smarte Korrekturen, bevor große Budgets gebunden sind.

Schritt 5: Adoption & Change als Pflichtbestandteil

Digitalisierungsprojekte scheitern selten an Technik, sondern an Adoption im Alltag. Schulung, klare Rollen, Kommunikation und Support gehören genauso dazu wie technische Entwicklung.

In der Praxis zeigt sich, dass gerade in öffentlichen Verwaltungen und großen Dienstleistern ohne systematische Change-Begleitung digitale Angebote formell eingeführt werden, aber nicht genutzt werden. Das ist ein klassisches Renditehemmnis.

Menschen müssen verstehen, warum eine Veränderung gut für sie ist, und sie müssen befähigt werden, sie anzuwenden.

Schritt 6: Controlling & kontinuierliche Verbesserung

Nach der Einführung ist vor der Verbesserung. Ein regelmäßiger Review-Rhythmus (z. B. monatlich oder quartalsweise) schafft Lern- und Anpassungsschleifen:

Was zeigt die Messung?

Welche Hypothesen haben sich bestätigt?

Wo ist Nachsteuerung nötig?

„Lessons Learned“ wird so kein Abschlusswort, sondern ein wiederkehrendes Ritual. Konsequentes Controlling sorgt dafür, dass Digitalrendite nicht erst am Ende, sondern laufend entsteht.

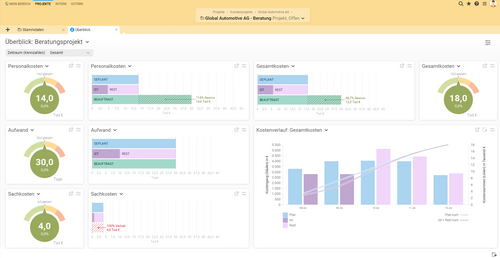

Wie Business Coordination Software Digitalrendite unterstützen kann

Bis hierhin ging es um Modelle, Wirklogiken und Kennzahlen. In der Praxis stellt sich jedoch die entscheidende Frage, wie sich Digitalrendite im Alltag tatsächlich herstellen lässt. Genau an diesem Punkt scheitern viele Organisationen: Die Ziele sind beschrieben, die Wirkung soll gemessen werden, doch die operative Umsetzung bleibt fragmentiert. Der Engpass liegt dabei oft nicht im Fehlen einzelner Tools, sondern in der mangelnden Koordination von Projekten, Ressourcen, Leistungen und Entscheidungen.

Genau diese Koordination ist einer der größten, oft unterschätzten Renditehebel von Digitalisierung. Integrierte Systeme wie Business Coordination Software setzen hier an, indem sie Informationen nicht nur erfassen, sondern in einen gemeinsamen Steuerungszusammenhang bringen. BCS kann dafür als Beispiel dienen.

Potenzielle Renditeeffekte solcher Systeme

Wo Systeme wie BCS ansetzen, lässt sich entlang einiger typischer Funktionsbereiche zeigen:

Projektplanung und -steuerung: Standardisierte Vorlagen, Meilensteine sowie Risiko- und Themenverfolgung schaffen vergleichbare und belastbare Projektstrukturen. Das reduziert Überraschungen und verbessert die Steuerbarkeit laufender Vorhaben.

Ressourcenplanung und Auslastungssteuerung: Transparenz über Kapazitäten, Skills und Verfügbarkeiten hilft, Engpässe früher zu erkennen, Überlastungen zu vermeiden und Auslastung gezielter zu steuern. Das verbessert Planbarkeit und Prognosefähigkeit.

Zeiterfassung und Leistungsnachweise: Wenn Zeiten und Leistungen direkt im Projektkontext erfasst werden, sinkt der Nachbearbeitungsaufwand. Gleichzeitig steigt die Qualität von Abrechnung, Nachkalkulation und wirtschaftlicher Auswertung.

Durchgängigkeit von Angebot, Budget und Controlling: Ein konsistenter Datenfluss von Angebot über Projekt bis zur Auswertung reduziert Medienbrüche und Interpretationsaufwand. Informationen müssen nicht mehrfach übertragen oder erklärt werden.

Reporting und Management-Dashboards: Aktuelle, integrierte Daten ersetzen manuelle Konsolidierung und verkürzen Entscheidungswege. Transparenz wird dadurch nicht Selbstzweck, sondern Grundlage für vorausschauende Steuerung.

Digitalrendite bei projektorientierten Dienstleistern

Besonders deutlich zeigt sich der Nutzen integrierter Systeme bei projektorientierten Dienstleistern, etwa in IT, Beratung, Engineering oder Agenturarbeit. Hier entscheidet sich wirtschaftlicher Erfolg weniger an einzelnen Produkten als an der Fähigkeit, Projekte zuverlässig, planbar und effizient umzusetzen.

Am Beispiel von BCS wird sichtbar, wie solche Systeme entlang der gesamten Projektlogik wirken können: Planung basiert auf einheitlichen Strukturen, Erfahrungswissen wird über Vorlagen und Standards wiederverwendbar, Risiken und Themen werden nicht informell, sondern strukturiert verfolgt. Das reduziert Unsicherheit und verbessert die Qualität der Projektsteuerung.

Ein zentraler Hebel liegt in der Ressourcenplanung. Statt isolierter Team- oder Bereichssichten entsteht ein organisationsweiter Blick auf Kapazitäten, Skills und Verfügbarkeiten. Dadurch werden Engpässe früher sichtbar, Prioritäten klarer und Projekte belastbarer planbar.

Auch bei Zeiterfassung, Leistungsdokumentation und Nachkalkulation zeigt sich Digitalrendite sehr konkret. Wenn Leistungen im selben Systemkontext erfasst, ausgewertet und weiterverarbeitet werden, sinken Korrekturen, Abrechnungszyklen verkürzen sich und wirtschaftliche Auswertungen werden belastbarer.

Digitalrendite im öffentlichen Sektor: Koordination, Transparenz und Steuerbarkeit

Im öffentlichen Bereich liegt der Schwerpunkt oft anders. Hier geht es weniger um Margen als um Koordination, Nachvollziehbarkeit und Handlungsfähigkeit in komplexen Vorhaben. Systeme wie BCS ersetzen dabei keine Fachverfahren und bilden Verwaltungsleistungen nicht im Detail ab. Ihre Stärke liegt dort, wo Programme, Projekte, Zuständigkeiten und Ressourcen über Organisationseinheiten hinweg zusammengeführt werden müssen.

Große Vorhaben wie OZG-Umsetzungen, Registermodernisierung oder ressortübergreifende Digitalisierungsprogramme bestehen aus vielen miteinander verknüpften Projekten. Zuständigkeiten sind verteilt, Zeitpläne greifen ineinander, Ressourcen sind knapp. Häufig fehlt in diesem Geflecht ein konsistenter Gesamtüberblick darüber, wo Projekte tatsächlich stehen, wo Verzögerungen entstehen und welche Abhängigkeiten kritisch werden.

Onlinezugangsgesetz (OZG)

Ziel: Verwaltungsleistungen digital anbieten (für Bürger & Unternehmen)

Beschlossen: 2017

Frist (ursprünglich): Ende 2022

Umfang: ca. 575 Verwaltungsleistungen

Umsetzung durch: Bund, Länder und Kommunen

Kernidee: „Einer für alle“ (EfA-Prinzip – eine Lösung wird nachnutzbar)

Zugang: über Verwaltungsportale (z. B. Bürgerportale)

Wichtige Bausteine: Online-Anträge, Nutzerkonten, digitale Identifikation

Status: teilweise umgesetzt, weiterhin im Ausbau (OZG 2.0)

Integrierte Koordinationssysteme schaffen hier eine gemeinsame Steuerungsebene. Projekt- und Portfoliostatus lassen sich einheitlich darstellen, Budgets vergleichbar verfolgen und Prioritäten transparent machen. Digitalrendite zeigt sich dann nicht primär als kurzfristige Einsparung, sondern als verbesserte Handlungs- und Entscheidungsfähigkeit.

Hinzu kommt die Nachvollziehbarkeit von Entscheidungen. In vielen Organisationen sind Beschlüsse, Änderungen und Begründungen über E-Mails, Präsentationen, Laufwerke und persönliche Ablagen verteilt. Werden diese Informationen im Projektkontext strukturiert dokumentiert, erhöht das Transparenz, Revisionssicherheit und Verlässlichkeit im Arbeitsalltag.

Ein weiterer wichtiger Hebel ist die Koordination externer Dienstleister. Leistungsstände, Abnahmen sowie Zeit- und Kostenentwicklungen lassen sich in integrierten Systemen im selben Zusammenhang darstellen wie interne Projektinformationen. Externe Beiträge werden dadurch nicht isoliert betrachtet, sondern als Teil des Gesamtvorhabens steuerbar.

Voraussetzungen: Wann aus Integration tatsächlich Digitalrendite wird

So wirksam integrierte Systeme sein können, ihr Nutzen ist nicht automatisch gegeben. Die beschriebenen Effekte setzen voraus, dass

Daten konsistent und vollständig erfasst werden

Prozesse ausreichend standardisiert sind

Rollen und Verantwortlichkeiten klar definiert sind

die Nutzung im Alltag diszipliniert verankert wird

Fehlen diese Voraussetzungen, entsteht keine Digitalrendite, sondern im schlimmsten Fall eine Verlagerung bestehender Komplexität in ein zentrales System. Der messbare Nutzen ergibt sich daher nicht aus der Software allein, sondern aus dem Zusammenspiel von System, Prozessdesign, Governance und Nutzung.

Einführungs-Blueprint: So starten Sie mit BCS auf Digitalrendite (statt „Tool zuerst“)

Ein häufiger Fehler bei Digitalisierungsinitiativen ist, dass zu viele Ziele gleichzeitig adressiert werden. Sinnvoller ist es, mit einem klar abgegrenzten Hebelbereich zu starten, Nutzen früh sichtbar zu machen und die Messung von Anfang an mitzudenken.

Ein hervorragendes Beispiel dafür liefert der Anwenderbericht der ECKD GmbH.

Jana Kurik, PMO bei ECKD

Die Einführung der neuen Projektmanagement-Software erfolgte … in einer dreimonatigen Pilotphase. In dieser Zeit konnten wir verschiedene Funktionen im Alltag prüfen und evaluieren, welche Anpassungen für unsere Arbeitsweise sinnvoll sind.

Was hier passiert ist genau das richtige Vorgehen: klein starten, nutzen, messen. ECKD hat sich insbesondere auf Projektplanung, Zeiterfassung und Controlling konzentriert. Gerade diese Kombination liefert sehr konkrete KPIs, z. B. Plan/Ist-Abweichungen, tatsächliche Zeiterfassung je Projekt oder die konsolidierte Sicht auf Projektfortschritte, ohne den Rahmen zu sprengen.

Ein zweiter Use Case, bei dem BCS messbare Wirkung erzeugt, zeigt der Anwenderbericht der gematik GmbH. Dort stand die Herausforderung an, Ressourcen über eine Matrix-Organisation hinweg konsistent zu planen und auswertbar zu machen:

Mirko Richter, People Analyst bei gematik GmbH

Ressourcenplanung war unter den bestehenden Voraussetzungen eine Herausforderung … Deshalb haben wir uns zur Einführung einer übergreifenden Lösung entschlossen, die unseren Projektleitenden und Linienverantwortlichen mehr Transparenz über die Auslastung ihrer Mitarbeitenden bieten konnte.

Die Anwenderberichte von ECKD und gematik zeigen zwei typische Einstiegspunkte:

Bei ECKD lag der Fokus auf Projektplanung, Zeiterfassung und Controlling, also auf einer Kombination, die schnell konkrete KPIs wie Plan/Ist-Abweichungen, Zeitaufwände und Projektfortschritte sichtbar macht.

Bei der gematik stand Ressourcenplanung und Portfolio-Reporting im Vordergrund, also die Transparenz über Auslastungen, Engpässe und Prioritäten in einer Matrix-Organisation.

Daraus lassen sich zwei sinnvolle Einstiegsmuster ableiten:

Projektcontrolling + Zeiterfassung + Reporting

Portfolio-Reporting + Ressourcenplanung

Kurzfristig entstehen hier oft Quick Wins durch bessere Transparenz, weniger Suchaufwand und konsistenteres Reporting. Langfristig entfaltet sich der eigentliche Renditehebel durch Standardisierung, belastbarere Forecasts, bessere Nachkalkulationen und höhere Steuerungsfähigkeit.

Datenmodell und Governance als Renditevoraussetzung

Ein integriertes System wird erst dann wirksam, wenn Daten konsistent, vergleichbar und vollständig sind. Datenmodell und Standards sind daher keine Nebensache, sondern strategische Voraussetzung. Organisationen müssen definieren:

was ein Projekt ist,

wie Statuswerte interpretiert werden,

welche Rollen und Berechtigungen gelten und

welche KPIs gemessen werden sollen.

Ebenso wichtig ist Governance:

Wer verantwortet Datenqualität?

Wer überprüft Kennzahlen?

Wer steuert nach, wenn Nutzung, Planbarkeit oder Transparenz hinter den Erwartungen zurückbleiben?

Erst mit klaren Verantwortlichkeiten, Review-Rhythmen und Feedback-Schleifen wird aus Systemnutzung tatsächlich steuerbare Wirkung.

Wann sich ein solcher Ansatz besonders lohnt

Integrierte Koordinationsansätze sind vor allem dann sinnvoll, wenn Koordination selbst zum Engpass geworden ist. Typische Hinweise darauf sind:

viele parallele Projekte mit personellen oder fachlichen Abhängigkeiten

hoher Abstimmungsaufwand zwischen Bereichen oder externen Beteiligten

verteilte Informationen in mehreren Systemen oder Excel-Dateien

aufwendiges, manuelles Reporting

geringe Transparenz über Auslastung, Prioritäten und Gesamtstatus

Je stärker diese Symptome ausgeprägt sind, desto eher kann ein integrierter Ansatz zur Grundlage messbarer Digitalrendite werden.

Checkliste & Entscheidungshilfe: Wann lohnt sich der BCS-Ansatz besonders?

Nicht jede Organisation braucht sofort eine Business Coordination Software. Der Einsatz von BCS lohnt sich dann, wenn Koordination zum Engpass wird und Transparenz nicht mehr mit vertretbarem Aufwand herzustellen ist. Die folgende Checkliste hilft dabei, das eigene Umfeld realistisch einzuordnen.

Je mehr der folgenden Punkte mit "Ja" beantworten, desto stärker profitieren Sie von BCS:

Quick-Wins vs. Langfristnutzen: Was Sie realistischerweise erwarten können

Ein häufiger Irrtum ist die Erwartung, Digitalrendite müsse sofort in allen Bereichen sichtbar werden. In der Praxis zeigen sich Effekte in zwei Wellen.

Kurzfristig entstehen Quick-Wins vor allem durch bessere Transparenz. Projektstatus, Ressourcenübersichten und konsistentes Reporting reduzieren Such- und Abstimmungsaufwand fast sofort. Diese Effekte sind wichtig, weil sie Vertrauen schaffen und Akzeptanz erhöhen.

Langfristig entfaltet sich der eigentliche Renditehebel. Standardisierte Projektstrukturen, belastbare Forecasts, bessere Nachkalkulationen und höhere Qualität in Planung und Umsetzung entstehen nicht über Nacht, sondern durch konsequente Nutzung und kontinuierliche Verbesserung. Hier wird aus Transparenz echte Steuerungsfähigkeit.

Beides gehört zusammen: Quick-Wins sichern den Einstieg, Langfristnutzen rechtfertigt die Investition.

FAQ: Häufige Fragen um Digitalrendite

Was ist der Unterschied zwischen Digitalrendite und ROI?

Der ROI betrachtet primär finanzielle Erträge im Verhältnis zu einer Investition. Digitalrendite geht weiter. Sie berücksichtigt auch nicht-monetäre Effekte wie Zeitersparnis, Qualität, Transparenz, Steuerungsfähigkeit oder Akzeptanz. Gerade bei Digitalisierungsvorhaben, insbesondere im öffentlichen Sektor, sind diese Effekte oft entscheidender als ein klassischer Kapitalrückfluss.

Welche KPIs sind „die wichtigsten“?

Es gibt keine universell richtigen Kennzahlen. Entscheidend ist, dass KPIs zur Zielsetzung passen. Für operative Prozesse sind Durchlaufzeiten oder Rückfragenquoten sinnvoll, für projektorientierte Organisationen Auslastung, Forecast-Genauigkeit oder Nachkalkulationsabweichungen, für Verwaltungen Nutzungs- und Abschlussquoten digitaler Services. Wichtig ist weniger die Anzahl der KPIs als ihre Relevanz für Steuerung und Entscheidung.

Wie lässt sich nicht-monetärer Nutzen seriös messen?

Nicht-monetärer Nutzen wird häufig über Vergleichswerte sichtbar: Vorher-/Nachher-Vergleiche, Trendverläufe oder standardisierte Befragungen. Zeitgewinne, Planbarkeit, Transparenz oder Zufriedenheit lassen sich auch ohne Umrechnung in Euro belastbar erfassen. Ziel ist nicht exakte Bepreisung, sondern eine nachvollziehbare Aussage über Wirkung.

Wie schnell lassen sich Effekte erkennen?

Das hängt stark von Ausgangslage und Umfang ab. Erste Effekte zeigen sich oft dort, wo Transparenz entsteht, etwa bei Projektstatus oder Ressourcenübersichten. Nachhaltige Effekte, zum Beispiel bessere Forecasts oder höhere Qualität, benötigen mehr Zeit, weil sie auf Lern- und Standardisierungsprozessen beruhen. Entscheidend sind klare Ziele, eine definierte Baseline und konsequente Nutzung.

Ist Digitalrendite auch ohne neue Software möglich?

Grundsätzlich ja. Auch Prozessanpassungen, klare Zuständigkeiten oder bessere Zieldefinitionen können Wirkung entfalten. In komplexen Umfeldern stößt dieser Ansatz jedoch schnell an Grenzen. Ohne integrierte Systeme bleibt Messung aufwendig und Steuerung fragmentiert. Software ist kein Selbstzweck, aber häufig notwendig für eine nachhaltige Digitalrendite.

Wie nützt eine Business Coordination Software der Digitalrendite?

Business Coordination Software verbindet Projektmanagement mit Ressourcensteuerung, Zeit- und Leistungsdaten, Controlling und Reporting in einem konsistenten System. Der Fokus liegt nicht auf einzelnen Projekten, sondern auf deren Zusammenspiel. Genau diese Koordination macht den Unterschied und schafft die Grundlage für messbare Digitalrendite.

Digitalrendite auf den Punkt gebracht: 5 Takeaways

Digitalisierung ist Aktivität. Digitalrendite ist Ergebnis.

Ohne Messlogik bleibt Nutzen Behauptung.

Wirkung entsteht nicht durch Tools, sondern durch Steuerbarkeit.

Public Value ist die Rendite der Verwaltung.

Koordination ist der größte, oft unterschätzte Renditehebel.

Über den Autor

Kai Sulkowski ist Redakteur in der Marketing-Abteilung der Projektron GmbH. In seinen Fachartikeln beschäftigt er sich mit Themen an der Schnittstelle von Digitalisierung, Projektmanagement und Unternehmenssteuerung. Für diesen Beitrag hat er aufbereitet, wie Organisationen den Nutzen digitaler Maßnahmen messbar machen können — von KPIs und Wirklogik bis zur Frage, wie Transparenz, Ressourcensteuerung und Controlling zur Digitalrendite beitragen.

Weitere Leseempfehlungen & Quellen

[1] DigitalService des Bundes: „Zählen, was zählt: Warum wir uns die Digitalrendite anschauen sollten“,https://digitalservice.bund.de/blog/zaehlen-was-zaehlt-warum-wir-uns-die-digitalrendite-anschauen-sollten, abgerufen im März 2026.↩

[2] eGovernment.de: Themenschwerpunkt „Digitalrendite“ und „Wirkungsorientierung“,https://www.egovernment.de, abgerufen im März 2026.↩

[3] Initiative D21 / Bundesministerium des Innern (BMI): eGovernment Monitor,https://initiatived21.de/publikationen/egovernment-monitor/, abgerufen im März 2026.↩

[4] Bitkom: Studien zur digitalen Verwaltung,https://www.bitkom.org/Themen/Oeffentliche-Verwaltung, abgerufen im März 2026.↩

[5] Nationaler Normenkontrollrat (NKR): Gutachten und Stellungnahmen zu E-Government und Digitalisierung,https://www.normenkontrollrat.bund.de, abgerufen im März 2026.↩

Weitere interessante Artikel im Projektron-Blog

Auswahl einer PM-Software

Steht in Ihrem KMU oder Ihrem Konzern die Auswahl einer Projektmanagement-Software an, wissen Sie vermutlich gar nicht, wo Sie mit der Suche nach dem für Sie passenden PM-Tool anfangen sollen. Dieser Guide bahnt Ihnen den Weg durch den PM-Software-Markt und führt Sie in 9 Schritten zur richtigen Entscheidung.

Projektmanagement-Software-Vergleich

Schaffen Sie sich einen aktuellen Überblick: Wir vergleichen 15 der beliebtesten und besten Projektmanagement-Software-Lösungen. Fangen Sie hier an, entdecken Sie den Markt und vergleichen Sie selbst!

Softwareeinführung

Die Einführung von Unternehmenssoftware ist komplex. Welche Einführungsstrategien gibt es? Welche Strategie eignet sich für welchen Zweck? Mit diesem Wissen führen Sie Ihr Einführungsprojekt zum Erfolg.

7 Vorteile PM-Software

Von besserer Excel-Tabelle bis hin zur umfassenden Business-Coordination-Software: Welche Vorteile bietet Projektmanagement-Software und für wen lohnt es sich, ein PM-Tool anzuschaffen? Wir liefern 7 gute Gründe, warum Ihr Unternehmen von Projektmanagement-Software profitiert.